por Rafael BoccardiEssa fotografia não existe.

Nunca houve o momento, a luz, o clique. Nenhum fotógrafo esteve lá.

Ela é o registro perfeito de algo que não aconteceu — e, ainda assim, você sente que pode acreditar.

“Fotografias fornecem evidência. Algo de que ouvimos falar, mas duvidamos, parece provado quando nos mostram uma fotografia disso.”

Durante décadas, esse foi o poder da fotografia: transformar dúvida em certeza. Cada registro carregava o peso do tempo e do espaço: o “aqui” e o “agora” impressos na imagem.

Hoje, a inteligência artificial desafia essa relação. Uma frase digitada em um prompt — “retrato de um protesto em 1982, sob chuva torrencial, capturado em película Kodak” — pode gerar uma imagem tão convincente quanto qualquer registro histórico. A diferença? Ela não documenta nada. É memória sem passado.

Prompt: Ultra-realistic black-and-white photojournalism portrait during a street protest in heavy rain, São Paulo, 1982. Tight close-up of a soaked young man centered, wet hair stuck to his forehead, intense eye contact; crowded frame with out-of-focus shoulders and heads as foreground occlusion; raindrops streaking across the image, water beads on skin. High-contrast Kodak Tri-X 400 film look, visible grain, shallow depth of field (85mm, f/2), slight motion blur on the rain, Leica rangefinder documentary aesthetic, cinematic lighting from a streetlamp. No banners, no text, no logos, no police. —ar 3:2 —style raw —v 6

QUANDO A PROVA DEIXA DE SER PROVA

Fotografias sempre puderam ser manipuladas. Desde os truques de estúdio no século XIX até o Photoshop, aprendemos a desconfiar. Mas havia um negativo, um fotógrafo, uma cena real.

Com imagens geradas por IA, essa base desaparece. Não há original, não há evento. A imagem nasce “pós-fato” — ou, pior, sem fato algum.

Isso desafia fundamentos de jornalismo, direito e história. Se qualquer pessoa pode criar uma “foto” de algo inexistente, como provar o que realmente aconteceu? Iniciativas como a Coalition for Content Provenance and Authenticity (C2PA) já tentam registrar a origem de arquivos digitais, mas a velocidade da desinformação supera de longe os mecanismos de verificação.

Essa realidade não é nova — apenas se sofisticou dramaticamente. Já em 2019, o Instituto Cappra alertava para os riscos da "guerra de desinformação" (p. 33) em um mundo em que qualquer pessoa tem acesso instantâneo a bilhões de informações. Na época, o problema estava na velocidade: uma busca simples retornava um bilhão de resultados em menos de um segundo, criando um oceano de dados em que verdade e mentira se misturavam indiscriminadamente.

O que mudou foi a natureza da evidência. Se antes precisávamos aprender a distinguir textos verdadeiros de falsos, hoje enfrentamos o desafio de questionar a própria realidade visual. A inteligência artificial transformou a criação de "provas" em um processo democratizado e instantâneo — qualquer prompt pode gerar uma fotografia convincente de algo que nunca aconteceu.

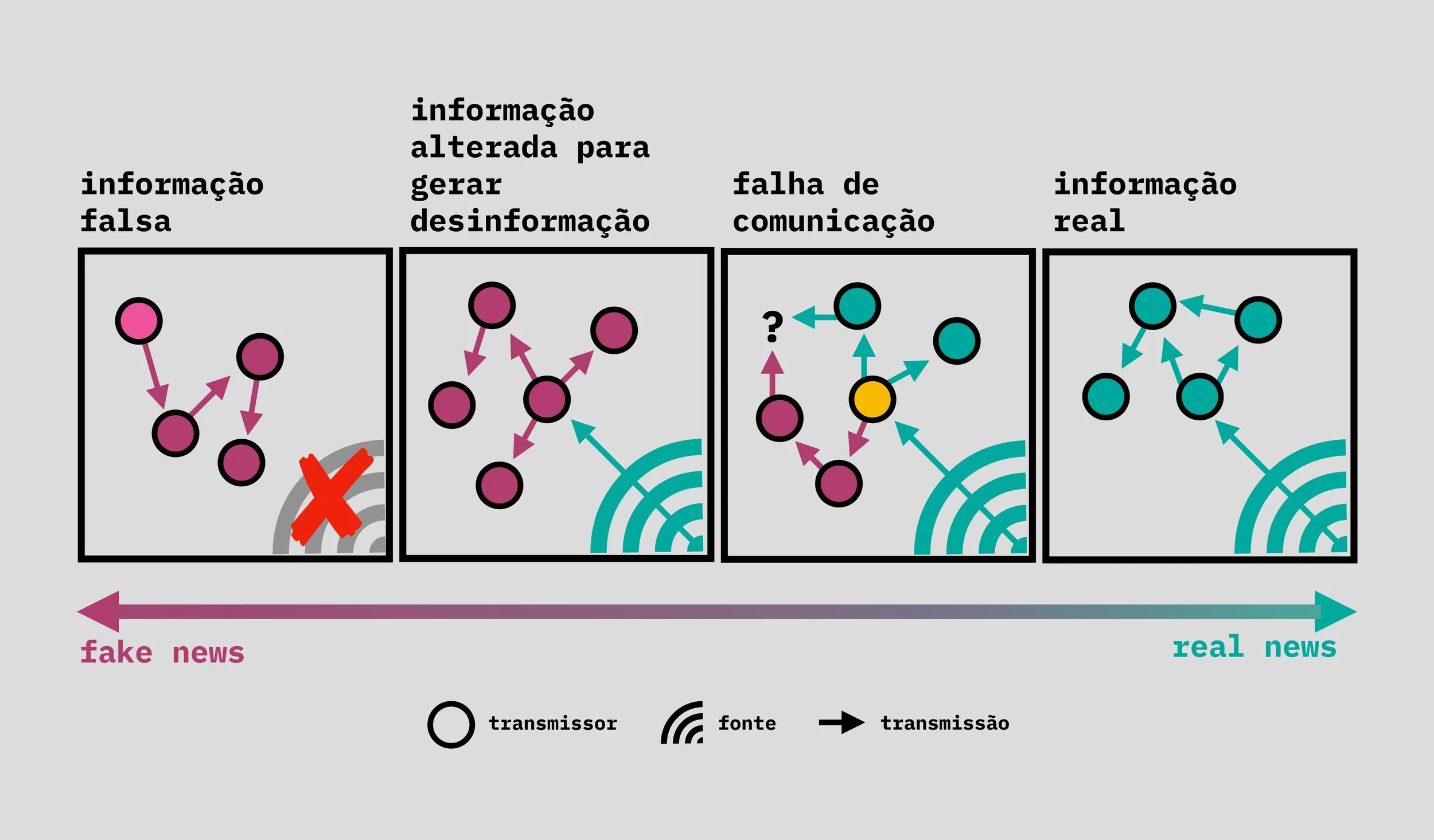

Infográfico: demonstração visual das diferentes formas de disseminação social da informação.

O IMPACTO PSICOLÓGICO: ENTRE O REAL E O PLAUSÍVEL

A força da fotografia está na sua capacidade de provocar reação imediata. E aqui mora o risco: imagens falsas convincentes acionam nossas emoções como se fossem reais.

Pesquisas já mostravam que as fake news visuais têm cerca de 70% mais chances de serem compartilhadas do que notícias textuais falsas — dado comprovado em um estudo do MIT publicado na Science em 2018. E isso foi antes mesmo da popularização das IAs generativas. Hoje, não falamos mais de montagens amadoras, mas de composições capazes de imitar a estética documental com perfeição, borrando as fronteiras entre registro e invenção.

Além da veracidade, há o dilema da autoria. As IAs são treinadas em bilhões de imagens, muitas vezes sem consentimento dos fotógrafos. Ao gerar uma “fotografia” no estilo de Sebastião Salgado ou Steve McCurry, a máquina não só imita a estética: ela se apropria de anos de prática, olhar e experiência.

Dois episódios recentes ilustram dramaticamente o que está em jogo: em 2023, uma obra criada por IA venceu o Sony World Photography Awards na categoria Criativo Aberto — e provocou indignação entre fotógrafos e artistas, que viram na premiação uma sinalização de que a sensibilidade humana poderia ser substituída por algoritmos.

Já em 2024, o fotógrafo Miles Astray registrou a célebre imagem do flamingo “sem cabeça” e a submeteu, como protesto simbólico, ao concurso 1839 Awards na categoria de IA. A foto conquistou o 3º lugar e o prêmio popular — até que ele revelou que era totalmente real. A obra foi desclassificada, mas não sem deixar uma importante reflexão sobre o valor da criatividade humana em tempos de IA.

PROBLEMAS CONCRETOS DAS FOTOGRAFIAS GERADAS POR IA

Desinformação política: fotos falsas influenciando opinião e eleições.

Difamação pessoal: deepfakes usados para destruir reputações.

Erosão da confiança pública: se tudo pode ser fabricado, até fotos reais passam a ser questionadas.

Apagamento cultural: estilos únicos absorvidos sem crédito ou remuneração aos artistas.

Ruído histórico: registros falsos misturados a arquivos reais, comprometendo pesquisas futuras.

CAMINHOS POSSÍVEIS

Proveniência digital: metadados que registrem origem e manipulações.

Educação visual: formar um público crítico diante de imagens.

Regulação ética: normas claras para o uso da IA visual em jornalismo e documentação.

Reconhecimento e compensação: garantir crédito e remuneração a artistas cujas obras servem de base para modelos generativos.

A fotografia sempre foi mais que luz e sombra. É memória, prova e narrativa.

Mas se deixarmos que imagens inventadas circulem sem contexto, corremos o risco de transformar o mundo em um álbum infinito de lembranças que ninguém viveu.

A pergunta não é se a máquina mente.

É: quando nós paramos de perguntar?